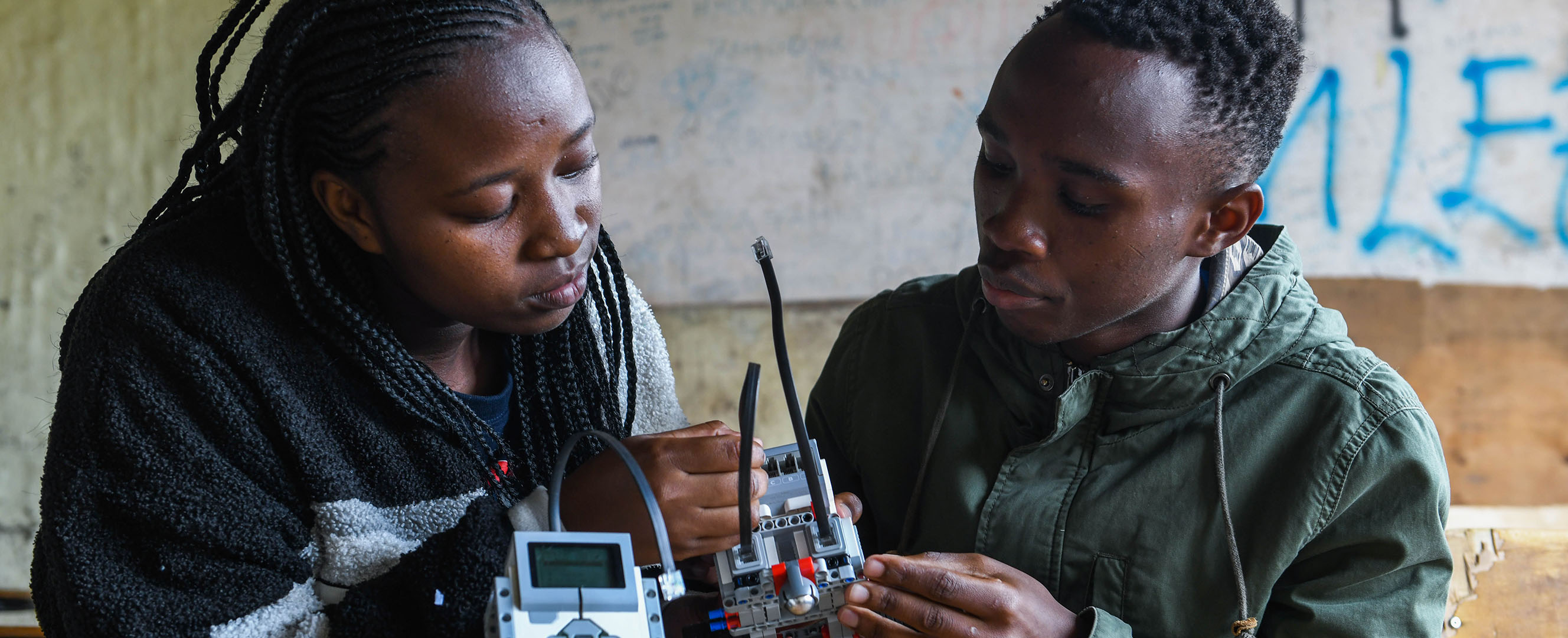

La inteligencia artificial debe adaptarse minuciosamente en beneficio de los pobres, según investigaciones realizadas en Kenya, Sierra Leona y Togo

La inteligencia artificial (IA) está transformando las economías en desarrollo, en un proceso que acarrea los consabidos riesgos de inestabilidad, información errónea y cuestiones de vigilancia, pero que también encierra una promesa de numerosas ventajas. Hay ejemplos recientes que ilustran cómo las tecnologías basadas en IA pueden focalizar la ayuda y el crédito más puntualmente y mejorar el acceso a la enseñanza y consultas médicas adaptadas a circunstancias específicas. Pero para equilibrar estos riesgos y oportunidades no basta con instalar y activar la tecnología existente; se precisan iniciativas de innovación y adaptación a escala local.

Los avances más recientes de la IA tuvieron su origen en países ricos; es decir, fueron concebidos en esos países para usuarios locales a partir de datos locales. En los últimos años hemos llevado a cabo investigaciones con socios en países de ingreso bajo, con aplicaciones de IA basadas en los usuarios y datos de esos países. En tales entornos, las soluciones basadas en IA funcionarán solo si encajan en el contexto social e institucional local.

En Togo, donde el gobierno utilizó tecnología de aprendizaje automático para focalizar las ayudas monetarias durante la pandemia de COVID-19, la adaptación de la IA a las condiciones locales fue clave para obtener buenos resultados. El gobierno aprovechó la tecnología originalmente concebida para focalizar los anuncios en línea y la adaptó para identificar a los habitantes más pobres del país. Usando IA, el sistema procesó datos de empresas satelitales y de tecnología móvil para detectar rasgos característicos de pobreza, como aldeas que aparecen menos desarrolladas en imágenes aéreas y suscriptores móviles con saldos bajos en sus teléfonos. La focalización basada en estos rasgos ayudó a garantizar que las transferencias de efectivo llegaran a las personas que más las necesitaban (Aiken et al., 2022).

Esta aplicación funcionó en Togo solo gracias a que el gobierno, en colaboración con investigadores y organizaciones sin fines de lucro, adaptó la tecnología a las necesidades locales. Idearon un sistema de distribución de pagos de dinero móvil que funcionaba para todos los abonados de teléfonos celulares, adaptaron el software existente de aprendizaje automático a las transferencias de efectivo, y entrevistaron a decenas de miles de beneficiarios para cerciorarse de que el sistema fuera coherente con la definición local de pobreza. Y aun así, la idea era que la solución basada en IA no sería permanente y se retiraría gradualmente una vez que terminara la pandemia. El programa basado en IA también generó otra inquietud: los algoritmos que funcionan bien en el laboratorio pueden no ser fiables cuando se emplean para tomar decisiones que revisten importancia en la práctica. Por ejemplo, en un sistema de focalización de la ayuda como el de Togo, las personas podrían modificar su conducta para conseguir prestaciones, socavando así la capacidad del sistema para canalizar efectivo a los pobres.

En otros casos, el aprendizaje automático se usa para determinar el cumplimiento de criterios que permiten obtener micropréstamos observando patrones de comportamiento de los teléfonos móviles (Björkegren y Grissen, 2020). Por ejemplo, en Kenya más de una cuarta parte de los adultos ha obtenido préstamos por medio de sus teléfonos móviles. Pero si tener más amigos en Facebook contribuye a que se apruebe un crédito, probablemente no faltarán solicitantes que opten por conseguir amigos rápidamente. Esto a la larga hará más difícil que los sistemas puedan identificar a las personas correctas.

En un estudio realizado con el Centro Busara en Kenya observamos que las personas podían aprender y modificar el comportamiento de sus teléfonos inteligentes en función de estas reglas algorítmicas (Björkegren, Blumenstock y Knight, de próxima publicación). Demostramos cómo el algoritmo, que se adelanta a estas respuestas, produce mejores resultados si se lo somete a un ajuste de la prueba de concepto. Pero la tecnología por sí sola no puede solucionar los problemas que surgen durante la implementación; buena parte del reto que supone construir estos sistemas es garantizar que sean fiables en condiciones reales.

Además, algunos sistemas han de someterse a un proceso de adaptación para que sean útiles. Por ejemplo, en muchos países de ingreso bajo, los profesores tienen que dictar clases numerosas con recursos limitados. En Sierra Leona, un socio local experimentó con un sistema de chatbot de IA para profesores llamado TheTeacher.AI, similar al ChatGPT pero adaptado al plan de estudios y la enseñanza locales, y al que se puede acceder incluso con conexiones a Internet deficientes. En la etapa piloto, muchos profesores no podían formular preguntas de un modo que generaran respuestas útiles, pero un grupo pequeño empezó a utilizar el sistema de forma regular para incorporar conceptos de enseñanza, la planificación de clases y el diseño de material para dictarlas (Choi et al., 2023). Para que los profesores pudieran usarlo en la práctica hizo falta entrenamiento y experimentación. Los múltiples usos de la IA quizá no resulten del todo obvios para quienes se beneficiarán de ellos, y descubrirlos dependerá de procesos de prueba y error y del intercambio de aplicaciones útiles.

Barreras de comunicación

Asimilar el potencial de IA probablemente será más difícil en los países de ingreso más bajo, donde las tasas de alfabetización y aritmética elemental de la población son más bajas y las personas están menos familiarizadas con los datos digitales y los algoritmos que procesan esta información. Por ejemplo, en un experimento realizado en Nairobi, Kenya, fue difícil explicar a personas de ingreso bajo los conceptos de algoritmos simples con números negativos y fracciones. Pero nuestro equipo buscó maneras más sencillas de comunicar estos conceptos, y cuando las personas respondieron al algoritmo no cabía duda de que los habían comprendido. De todos modos, los sistemas de IA complejos son difíciles de entender, incluso para los propios investigadores.

Algunas aplicaciones no requieren que los usuarios sepan cómo funcionan los algoritmos. Por ejemplo, las recomendaciones de películas de Netflix pueden ayudar a los usuarios incluso si estos no entienden cómo el algoritmo selecciona lo que intuye que podría resultarles interesante. De igual forma, en una crisis humanitaria, las autoridades pueden considerar aceptable recurrir a un algoritmo inescrutable de “caja negra”, como lo hizo el gobierno de Togo en respuesta a la crisis de la COVID-19.

La transparencia a veces es crucial. Al momento de focalizar las ayudas sociales cuando no se está en una situación de emergencia, es esencial explicar a los posibles beneficiarios los criterios de acceso. Pero del dicho al hecho hay un gran trecho: decenas de entrevistas y grupos de enfoque revelan diferencias fundamentales en las normas y los valores sobre datos y privacidad entre un entorno rural como el de Togo y el de los países ricos donde los sistemas basados en IA son más comunes. Por ejemplo, pocas personas con las que hablamos se mostraron preocupadas de que el gobierno o las empresas tuvieran acceso a sus datos (una de las principales preocupaciones en Europa y Estados Unidos), pero muchas se preguntaban en qué medida y de qué manera la información se compartiría con sus vecinos.

Conforme el uso de la IA se va masificando, las poblaciones tienen que comprender sus efectos más amplios en la sociedad. Por ejemplo, la IA puede generar fotos provocativas que son absolutamente falsas y llamadas robotizadas que imitan voces. Estos rápidos cambios afectarán el grado en que las personas han de confiar en la información que ven en línea. Incluso los habitantes en zonas remotas tienen que ser puestos al corriente de estas posibilidades para evitar que sean engañados, y para garantizar que sus intereses se tengan en cuenta al momento de elaborar las regulaciones.

Establecer conexiones

Las soluciones de IA dependen de la infraestructura digital física ya existente: desde las enormes bases de datos en servidores hasta los teléfonos móviles que usan las personas, pasando por los cables de fibra óptica y las torres de telefonía celular. En los últimos 20 años, las economías en desarrollo han invertido mucho en comunicar zonas alejadas mediante conexiones celulares y de Internet, lo cual ha sentado las bases para estas nuevas aplicaciones.

Las aplicaciones de IA se benefician de la infraestructura digital, pero algunas podrían explotar mejor los recursos existentes. Por ejemplo, muchos docentes en Sierra Leona luchan contra un acceso a Internet deficiente. Para ciertas tareas quizá resulte más fácil obtener las ideas de un chatbot y validar luego las respuestas que cotejar información extraída de distintos recursos en línea.

Sin embargo, algunos sistemas de IA requerirán inversiones en infraestructura del conocimiento, sobre todo en países avanzados, donde persisten las deficiencias de datos y los pobres no están lo suficientemente cubiertos desde el punto de vista digital. Los modelos de IA disponen de información incompleta sobre las necesidades y las aspiraciones de los ciudadanos de menores ingresos, su estado de salud, el aspecto de las personas y los poblados, y la estructura de los idiomas menos comunes.

Para recopilar estos datos quizá sea necesario integrar clínicas, colegios y empresas en sistemas de registro digital, incentivar su uso y establecer derechos legales sobre los datos resultantes.

Además, los sistemas de IA deben adaptarse a los valores y las condiciones locales. Por ejemplo, es posible que los sistemas de IA occidentales recomienden a los profesores usar recursos costosos como pizarras digitales o presentaciones de diapositivas digitales. Estos sistemas han de modificarse de modo que resulten útiles para los profesores que carecen de estos recursos. Invertir en la capacidad y la capacitación de los programadores y diseñadores locales de IA puede ayudar a garantizar que la próxima ola de innovación técnica refleje mejor los valores y las prioridades de cada lugar.

La IA encierra la promesa de muchas aplicaciones útiles para los pobres en las economías en desarrollo. La encrucijada no está en soñar a lo grande —es fácil imaginar cómo estos sistemas pueden beneficiar a los pobres—, sino en garantizar que estos sistemas colmen las necesidades de las personas, se adapten a las condiciones locales y no causen ningún daño.

Las opiniones expresadas en los artículos y otros materiales pertenecen a los autores; no reflejan necesariamente la política del FMI.

Referencias:

Aiken, Emily, Suzanne Bellue, Dean Karlan, Chris Udry, and Joshua E. Blumenstock. 2022. “Machine Learning and Phone Data Can Improve Targeting of Humanitarian Aid.” Nature 603 (7903): 864–70. https://0-doi-org.library.svsu.edu/10.1038/s41586-022-04484-9.

Björkegren, Daniel, and Darrell Grissen. 2020. “Behavior Revealed in Mobile Phone Usage Predicts Credit Repayment.” World Bank Economic Review 34 (3): 618–34. https://0-doi-org.library.svsu.edu/10.1093/wber/lhz006.

Björkegren, Daniel, Joshua E. Blumenstock, and Samsun Knight. Forthcoming. “Manipulation-Proof Machine Learning.”

Choi, Jun Ho, Oliver Garrod, Paul Atherton, Andrew Joyce-Gibbons, Miriam Mason-Sesay, and Daniel Björkegren. 2023. “Are LLMs Useful in the Poorest Schools? theTeacherAI in Sierra Leone.” Paper presented at the Neural Information Processing Systems (NeurIPS) Workshop on Generative AI for Education (GAIED).