D’après des études réalisées au Kenya, en Sierra Leone et au Togo, l’IA doit être soigneusement adaptée pour que les pauvres en tirent parti

L’intelligence artificielle (IA) entraîne une transformation en profondeur de l’économie des pays en développement qui soulève des risques bien connus (perturbation, mésinformation et surveillance), mais qui fait aussi miroiter de nombreux bienfaits potentiels. Des exemples récents montrent que les technologies faisant appel à l’IA permettent de mieux cibler l’aide et le crédit, et d’améliorer l’accès à un enseignement et à des conseils médicaux sur mesure. Cependant, pour mettre en équilibre ces risques et possibilités, il ne suffit pas d’utiliser les technologies existantes ; des innovations et des adaptations au niveau local sont aussi nécessaires.

La plupart des avancées récentes en matière d’IA ont été réalisées dans des pays riches pour leurs utilisateurs, à l’aide de données locales. Ces dernières années, nous et nos partenaires avons fait de la recherche sur l’IA dans des pays à faible revenu, qui portait plus précisément sur des applications adaptées aux utilisateurs de ces pays et fondées sur des données locales. Dans ces pays, le succès des solutions fondées sur l’IA passe par leur adaptation au contexte social et institutionnel local.

Au Togo, où le gouvernement a eu recours à l’apprentissage automatique pour cibler l’aide monétaire pendant la pandémie de COVID-19, nous avons constaté que la localisation de l’IA était la clé du succès. Le gouvernement a utilisé une technologie initialement conçue pour le ciblage de la publicité en ligne afin de recenser les habitants les plus pauvres du pays. Un système d’IA a traité des données transmises par des satellites et des opérateurs de téléphonie mobile afin de déterminer les signes de la pauvreté, tels que le sous-développement des villages qui ressort des images aériennes et les abonnés aux services mobiles ayant peu de crédit sur leur téléphone. Grâce à un ciblage fondé sur ces signes, le gouvernement a pu s’assurer que les transferts en espèces parvenaient aux personnes qui en avaient le plus besoin (Aiken et al., 2022).

Le succès de cette application au Togo réside dans l’adaptation de la technologie aux besoins locaux par le gouvernement, en collaboration avec des chercheurs et des organisations sans but lucratif. Ces acteurs ont élaboré un système de transfert de fonds par téléphone mobile pouvant être utilisé avec tous les abonnés à la téléphonie mobile, adapté un logiciel d’apprentissage automatique pour cibler les transferts en espèces, et interrogé des dizaines de milliers de bénéficiaires pour s’assurer que le système reflétait la définition locale de la pauvreté. Ce système ne se voulait toutefois pas une solution pérenne et devait être progressivement retiré après la pandémie.

Le programme fondé sur l’IA a soulevé une autre préoccupation : les algorithmes qui donnent de bons résultats en laboratoire peuvent ne pas être fiables lorsqu’ils sont exécutés pour la prise de décisions importantes sur le terrain. Par exemple, avec un système de ciblage de l’aide analogue à celui élaboré au Togo, les gens pourraient adapter leur comportement pour avoir droit aux allocations, ce qui compromettrait la capacité du système à aider les pauvres.

L’apprentissage automatique est également utilisé pour déterminer l’admissibilité aux microcrédits, sur la base de l’usage de la téléphonie mobile (Björkegren et Grissen, 2020). Par exemple, au Kenya, plus du quart des adultes ont contracté des emprunts en utilisant leur téléphone portable. Toutefois, si les personnes ayant le plus grand réseau d’amis sur Facebook sont plus susceptibles de voir leur demande de crédit approuvée, cela pourrait inciter des demandeurs à élargir rapidement leur réseau d’amis. En somme, le système pourrait avoir du mal à s’assurer que le programme bénéficie aux personnes visées.

Dans le cadre d’une étude menée avec le Busara Center au Kenya, nous avons constaté que les gens pouvaient apprendre et adapter leur utilisation du téléphone mobile à ces règles algorithmiques (Björkegren, Blumenstock et Knight, à paraître). Nous avons démontré comment un ajustement de l’algorithme visant à valider le concept, qui anticipe ces réponses, permettait d’obtenir de meilleurs résultats. Cependant, la technologie ne peut, à elle seule, résoudre les problèmes de mise en œuvre ; la principale difficulté que doivent surmonter les concepteurs de tels systèmes consiste à s’assurer de leur fiabilité dans des conditions réelles.

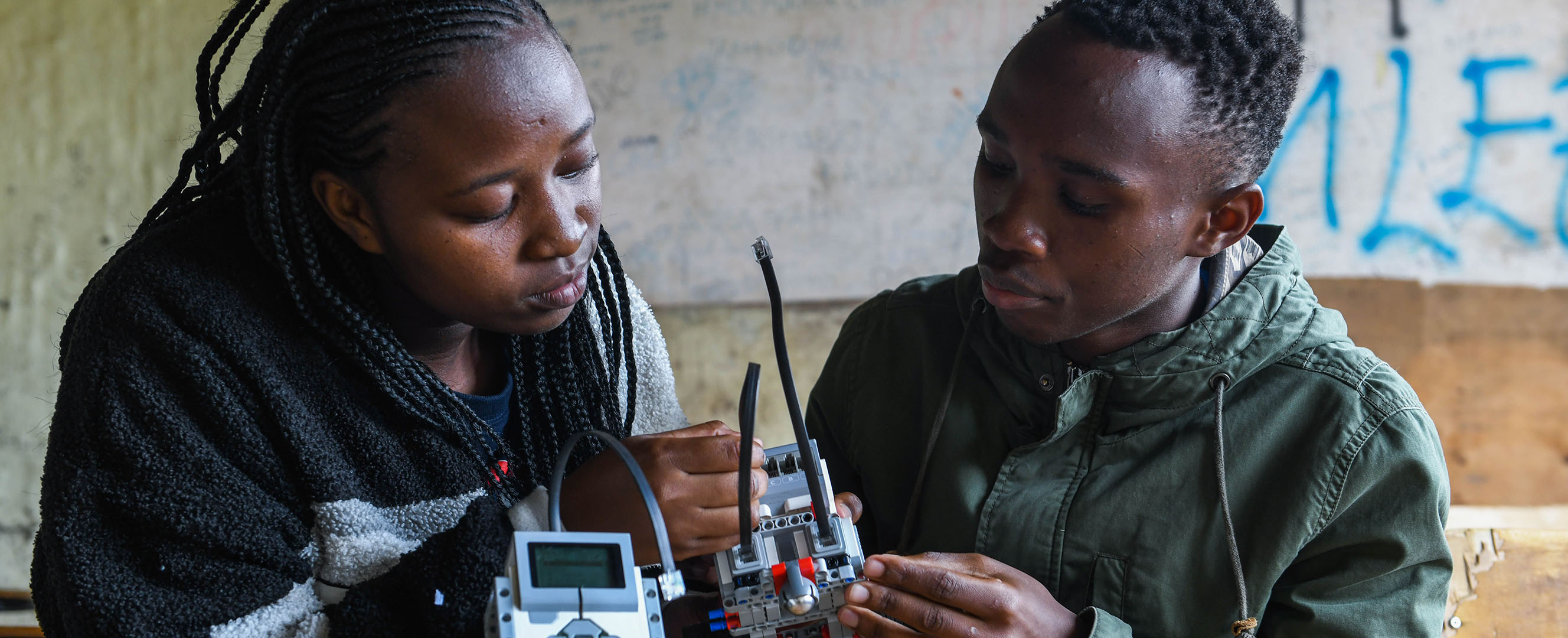

D’autre part, certains systèmes doivent être adaptés pour être utiles. Par exemple, dans nombre de pays à faible revenu, les enseignants disposent de ressources limitées pour s’occuper de classes nombreuses. En Sierra Leone, un partenaire local a mis à l’essai un agent conversationnel fondé sur l’IA à l’intention des enseignants, appelé TheTeacher.AI. Similaire à ChatGPT, ledit agent a été adapté au programme d’enseignement national et est accessible même lorsque la connexion à Internet est mauvaise. Au cours de la phase d’essai, de nombreux enseignants n’ont pas pu formuler leurs questions de manière à obtenir des réponses utiles, mais un petit groupe a commencé à utiliser régulièrement le système pour enseigner des concepts, planifier des leçons et élaborer des supports didactiques (Choi et al., 2023). La formation et l’expérimentation ont été des prérequis à l’utilisation du système par les enseignants. Pour les utilisateurs potentiels, les avantages de l’IA ne sautent pas forcément aux yeux ; la découverte des nombreuses utilisations est tributaire d’une approche par tâtonnements et de l’accès à des applications utiles.

Obstacles à la communication

Il est sans doute plus difficile d’appréhender le potentiel de l’IA dans les pays à faible revenu, où les compétences en lecture et en calcul sont plus faibles et où les données numériques et les algorithmes utilisés pour les traiter ne sont pas bien connus. Par exemple, dans le cadre de l’expérience réalisée sur le terrain à Nairobi (Kenya), nous avons eu du mal à expliquer à des personnes à faible revenu des algorithmes simples utilisant des nombres négatifs et des fractions. Notre équipe a cependant trouvé des moyens plus simples de communiquer ces concepts. Les personnes qui ont réagi à l’algorithme avaient manifestement compris le concept. Il n’en reste pas moins que les systèmes d’IA complexes sont difficiles à comprendre, même pour les chercheurs.

Certaines applications n’exigent pas de connaître le fonctionnement des algorithmes. Par exemple, les suggestions de contenu communiquées par Netflix à ses abonnés peuvent être utiles à ces derniers, même s’ils ne savent pas comment fonctionne l’algorithme qui en est à l’origine. De même, en cas de crise humanitaire, les décideurs peuvent privilégier un algorithme opaque de type « boîte noire », comme l’a fait le gouvernement togolais en réponse à la crise de la COVID-19.

La transparence est parfois capitale. Lorsque l’on prend des mesures de protection sociale dans une situation non urgente, il est essentiel d’expliquer les critères d’admissibilité aux bénéficiaires potentiels. Voilà qui est plus facile à dire qu’à faire : il ressort de nombreux entretiens et groupes de discussion que les normes et les valeurs relatives aux données et à la confidentialité sont fondamentalement différentes dans un contexte tel que le Togo rural et dans les pays riches où les systèmes d’IA sont plus courants. Par exemple, peu de nos interlocuteurs étaient préoccupés par l’accès du gouvernement ou des entreprises à leurs données (une préoccupation majeure en Europe et aux États-Unis), mais nombre d’entre eux souhaitaient savoir si et comment ces informations allaient être communiquées à leurs voisins.

L’IA étant de plus en plus utilisée, les populations doivent connaître son incidence sur la société. Par exemple, l’IA peut générer des photographies provocantes entièrement fausses et des appels robotisés qui reproduisent la voix d’une personne. Ces changements rapides détermineront dans quelle mesure les informations accessibles en ligne sont dignes de confiance. Même les populations isolées doivent être sensibilisées si l’on veut éviter qu’elles soient induites en erreur et s’assurer que leurs préoccupations sont prises en compte dans l’élaboration des réglementations.

Forger des liens

Les solutions d’IA reposent sur l’infrastructure numérique matérielle existante, allant des énormes bases de données installées sur des serveurs aux câbles de fibre optique et aux tours de transmission cellulaire, en passant par les téléphones portables. Au cours des deux dernières décennies, les pays en développement ont investi massivement afin que les zones éloignées aient accès à la téléphonie mobile et à Internet pour ainsi jeter les bases de ces nouvelles applications.

Même si les applications d’IA bénéficient d’une infrastructure numérique, certaines d’entre elles pourraient mieux utiliser les ressources existantes. Par exemple, en Sierra Leone, de nombreux enseignants ont du mal à accéder à Internet. Pour certaines tâches, il peut être plus facile de consulter un robot conversationnel, puis de valider sa réponse, que de rassembler des informations à partir de plusieurs ressources en ligne.

Certains systèmes d’IA nécessiteront toutefois des investissements dans l’infrastructure du savoir, en particulier dans les pays en développement, où les lacunes en matière de données persistent et où les pauvres sont sous-représentés dans le monde numérique. Dans ces pays, les modèles d’IA disposent d’informations incomplètes sur les besoins, les aspirations et l’état de santé des personnes à faible revenu, sur l’apparence des personnes et des villages, et sur la structure des langues moins usuelles.

Pour recueillir les données manquantes, il peut être nécessaire d’intégrer les cliniques, les écoles et les entreprises dans des systèmes d’archivage numériques, d’accorder des incitations à leur utilisation et d’établir la légitimité des droits sur les données obtenues.

Par ailleurs, les systèmes d’IA devraient être adaptés aux valeurs et aux conditions locales. Par exemple, on peut supposer que les systèmes d’IA utilisés en Occident amènent les enseignants à recourir à du matériel coûteux tel que des tableaux blancs ou des diapositives numériques. Ces systèmes doivent être adaptés aux enseignants qui ne disposent pas de ces ressources. En investissant dans les capacités et la formation des développeurs et concepteurs locaux de systèmes d’IA, on peut s’assurer que la prochaine génération d’innovations techniques reflétera mieux les valeurs et les priorités locales.

L’IA laisse entrevoir de nombreuses applications utiles pour les démunis dans les pays en développement. La difficulté n’est pas de voir grand — on peut imaginer sans peine les bienfaits pour les pauvres —, mais plutôt de s’assurer que ces systèmes sont adaptés aux besoins des personnes et au contexte local, et ne causent pas de préjudice.

Les opinions exprimées dans la revue n’engagent que leurs auteurs et ne reflètent pas nécessairement la politique du FMI.

Bibliographie :

Aiken, Emily, Suzanne Bellue, Dean Karlan, Chris Udry, and Joshua E. Blumenstock. 2022. “Machine Learning and Phone Data Can Improve Targeting of Humanitarian Aid.” Nature 603 (7903): 864–70. https://0-doi-org.library.svsu.edu/10.1038/s41586-022-04484-9.

Björkegren, Daniel, and Darrell Grissen. 2020. “Behavior Revealed in Mobile Phone Usage Predicts Credit Repayment.” World Bank Economic Review 34 (3): 618–34. https://0-doi-org.library.svsu.edu/10.1093/wber/lhz006.

Björkegren, Daniel, Joshua E. Blumenstock, and Samsun Knight. Forthcoming. “Manipulation-Proof Machine Learning.”

Choi, Jun Ho, Oliver Garrod, Paul Atherton, Andrew Joyce-Gibbons, Miriam Mason-Sesay, and Daniel Björkegren. 2023. “Are LLMs Useful in the Poorest Schools? theTeacherAI in Sierra Leone.” Paper presented at the Neural Information Processing Systems (NeurIPS) Workshop on Generative AI for Education (GAIED).